英伟达凑齐了人形机器人开发“三大件”——超级计算机DGX(训练算力)、融合了Cosmos的仿真平台Omniverse(训练数据)、终端芯片JetsonThor(推理算力)。

春节前夕,黄仁勋照例开启年会巡演,北京站成为各路CEO追星现场。大合照中,坐在黄仁勋左边的是宇树科技的王兴兴,第一排最右是银河通用的王鹤。

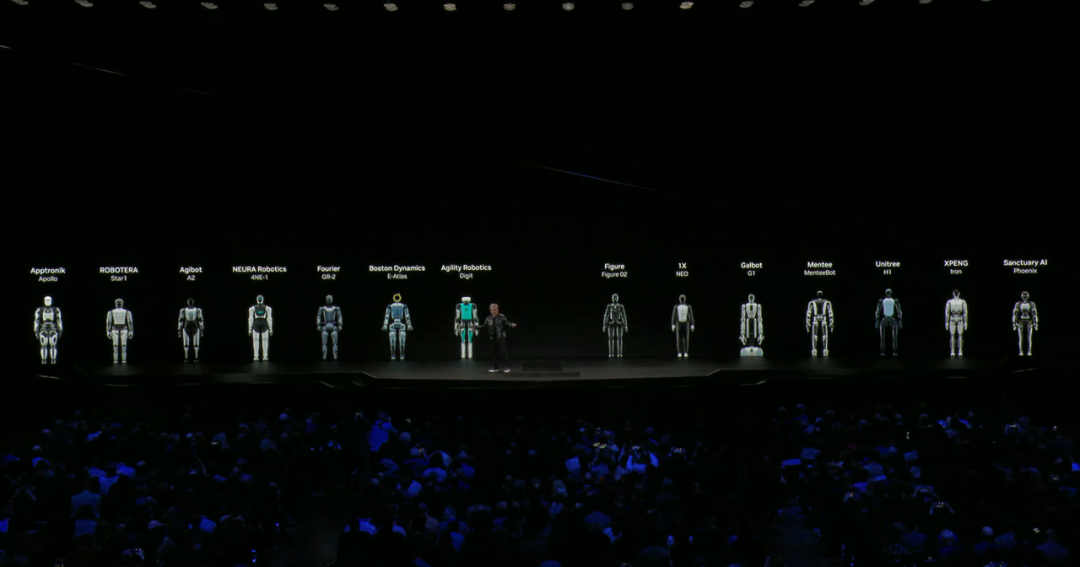

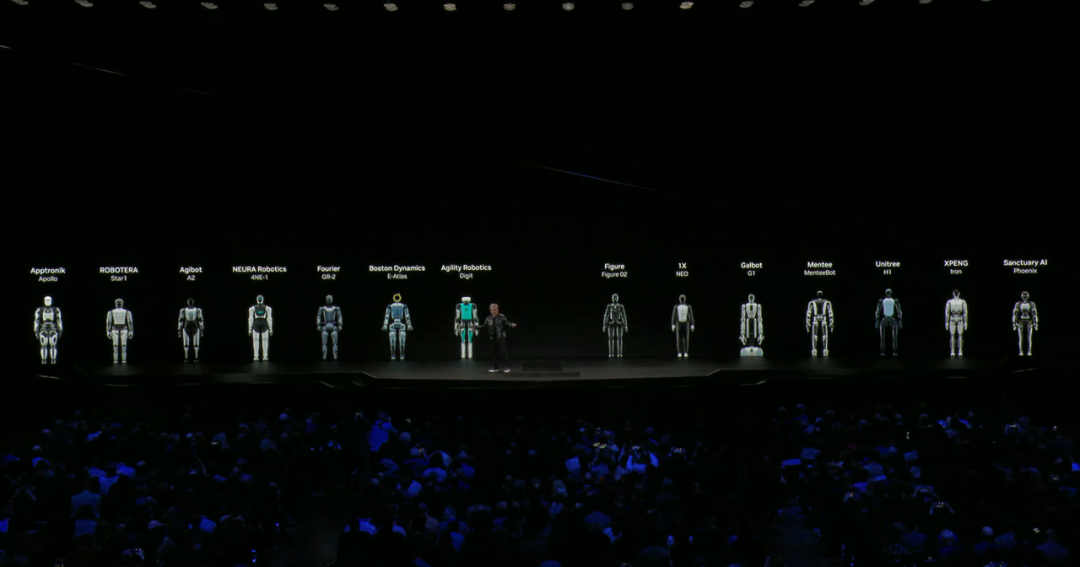

三人曾在年初的CES展上有过一次“非正式会谈”,当时黄仁勋演讲到尾声,人形机器人军团压轴登场,其中就包括宇树在春晚转手绢的H1、银河通用的Galbot G1。

英伟达年会与2025年CES展

发布会现场,14台人形机器人一字排开,有波士顿动力这种老牌选手,有宇树这样的行业新贵,还有跨界玩家小鹏,唯独缺席了一边买黄总的芯片一边悄悄搞自研的特斯拉。在机器人军团压轴登场前,黄仁勋公布了一系列大模型组成的机器人训练平台Cosmos。Cosmos的作用可以简单理解为在虚拟世界模拟真实的物理环境,瞄准的是当前人形机器人产业的真空带、也是英伟达围绕人形机器人布局的最后一环——仿真数据。三个月后的英伟达GTC,机器人再度成为压轴节目。除了Cosmos再度刷脸,英伟达还发布了一个人形机器人基础模型Isaac GR00T N1,仿真物理模型Newton,并由小机器人Blue完成收尾。如果把人形机器人视为人工智能领域一条正在疯狂施工的高速公路,那么英伟达正在做的事情,就是提前把收费站先修好。五年高考三年模拟

从年初的CES到前两天的GTC,英伟达真正的关键词是“物理AI”。按照黄仁勋的说法,AI的新一波浪潮是物理AI,其关键环节是让AI理解物理定律,人形机器人则是当下最重要的载体。传统的工业机器人大多基于特定的规划执行特定的操作,比如运输和分拣,与其说机器人,倒不如说是一种“自动化设备”。但人形机器人在理想状态下,可以理解物理世界各种物体、语言和文字的含义,并自主规划和决策。2023年7月,《纽约时报》探班谷歌实验室,记录了一个基于RT-2模型的机器人智能闪现的瞬间:桌子上放着恐龙、鲸鱼、狮子三个塑料玩具,工程师让机器人“捡起灭绝的动物”,机器人拿起了恐龙。这个案例很好的说明了人形机器人最大的变革:机器人不仅能识别三种动物,也能理解“灭绝的动物”的含义,还可以完成具体的操作。也就是说,两者的核心区别在“智能”。判断机器人的智能化程度,不是看它会不会前后空翻大劈叉,而是能不能像人一样思考。和大模型训练一样,让机器人拥有思考能力的过程,同样是对数据的消耗——换句话说就是刷题。人工智能泰斗级人物李飞飞曾对算法的训练过程有一个形象的解释:让算法不断观察包含猫和其他动物的图片,在每张图片背后写下正确答案。计算机每看一次图片,就和背面的答案核对一次。只要次数够多,算法就能学会辨别猫。和GPT等大模型爬取互联网数据不同,机器人会和真实世界产生交互,因此需要遵循物理规则的真实数据来训练算法。但如果用真人动作捕捉来训练,不仅成本高,也容易坐实“AI奴役人类”的地狱笑话。之中的数据空白,就成为了仿真数据的实践空间。所谓仿真数据,可以简单理解为在虚拟空间构建遵循真实世界物理规则的场景,并输出为可以被用来训练的数据。马斯克就是仿真数据的铁杆粉丝,2021年的特斯拉AI Day,马斯克曾公开过自家数据仿真技术,当时生成并投入训练的仿真数据规模就已经达到了37.1亿张图片和4.8亿标注[2]。xAi最新发布的Grok 3,也投喂了大量仿真数据用于训练。自动驾驶尚且可以搜集车主真实的行驶数据用于训练,机器人尚未大规模投入应用,对仿真数据的需求更为迫切。真实数据和仿真数据就像“五年高考”和“三年模拟”,一个是真题,一个是模拟题。真题的参考价值更高,但数量有限,模拟题量大管饱,但参考价值要看它与真题的相似程度。至此,英伟达凑齐了人形机器人开发“三大件”——超级计算机DGX(训练算力)、融合了Cosmos的仿真平台Omniverse(训练数据)、终端芯片Jetson Thor(推理算力)。物理骗术和算力游戏

在虚拟世界构建物理规则这件事上,英伟达的积累恐怕比大部分人想象的深厚。一项技术的应用并不取决于技术本身,而是能否绑定一个高商业价值的场景,实现自我造血的良性循环。在机器人和自动驾驶大规模产业化之前,最匹配这项技术的英伟达的老本行:游戏。大多数游戏都是对现实世界的模拟,但虚拟世界并不遵循现实世界的物理规则,小到游戏世界草木树叶飘动的方向、服装布料的褶皱,大到刀剑挥砍的力度和反馈效果,都会影响游戏的“沉浸感”。一种改进思路由此产生:为什么不用物理公式计算物体的实时运动状态、设计运动轨迹呢?当时,一家名叫Ageia的初创公司开发了物理引擎PhysX,通过对游戏画面中的物体做“受力分析->代入运动方程->更新位置信息->输出”的实时循环计算[3],让游戏中的场景尽可能贴合真实世界的物理规则。由于PhysX需要消耗大量算力,Ageia还专门开发了配套的硬件PPU(Physics Processing Unit)专门负责物理运算。可惜PPU销量惨淡,Ageia濒临倒闭,黄仁勋骑着白马就来了。收购完成后,英伟达干的第一件事就是砍掉PPU产品线,将PhysX的计算工作交给自家的GPU,并推出针对游戏开发的软件工具箱PhysX APEX,降低使用门槛。由于PhysX的特性是对物理规则的模拟和仿真,此后几年,英伟达还推动了PhysX在医疗手术、影视特效等工业场景的应用。2019年,英伟达在GPU架构中引入RT核心,推出了光线追踪功能。和PhysX类似,光线追踪的核心同样是对真实物理规则的模拟——根据物体和光源、障碍物间的相对位置,实时计算出光线反射至人眼的状态[4],每束光线的实时计算结果组合成一帧的画面,让英伟达狠狠秀了一把算力的肌肉。伴随自动驾驶、人形机器人这些新产业的出现,“在虚拟世界模拟物理规则”的需求也越来越大。Cosmos和Omniverse等软件工具的出现,相当于英伟达给人形机器人建了个可以沉浸式训练的“健身房”,接下来就可以卖“私教课”了——你看我的芯片怎么样?英伟达的野心

过去二十年,英伟达的经营思路可以用一句话来概括:让高性能计算不断覆盖高价值的场景。GPU是高性能计算的载体,也是英伟达的核心产品。2010年之前,虽然一些学者已经开始使用GPU训练神经网络,但GPU对应的高价值场景其实只有游戏一个。按照黄仁勋的说法,游戏市场“既代表着最棘手的技术难题,又具备惊人的市场规模,同时拥有这两个特质的市场非常罕见。”英伟达开拓的第一个新场景是移动设备。2013年小米3发布,处理器采用高通骁龙800和英伟达的Tegra系列混搭,是英伟达切入手机市场,开辟显卡之外第二战线的绝佳机会。当时,英文不好的雷军和中文不好的黄仁勋罕见同台,黄仁勋现场还当了一回米粉。可惜Tegra芯片因为制程和外挂基带问题,能耗失控发热严重。英伟达的移动业务此后也未见起色,Tegra系列只能在任天堂Switch上发挥余热。后来黄仁勋去台大演讲,称英伟达“主动放弃”了智能手机市场。第二个场景是自动驾驶。最先吃螃蟹的是特斯拉,Model S/X都曾搭载过英伟达的方案。黄仁勋也从米粉变成特斯拉车主,跟马斯克如胶似漆。虽然特斯拉后来用自研方案替代了英伟达,但有了榜样的力量,英伟达还是顺利打入造车新势力内部。不过汽车业务在英伟达的版图中远不如游戏和数据中心耀眼,营收占比几乎从未超过5%。第三个场景是人工智能。ChatGPT的横空出世让英伟达彻底打开收入天花板,计算机视觉、大语言模型等前沿计算机科学统统都离不开英伟达的芯片,也让后者成为了全球市值最高的半导体公司。2016年,马斯克作为OpenAI董事长签收英伟达DXG-1第四个场景就是人形机器人,以及更加广阔的“物理AI”。按照黄仁勋的说法,“我们正处于生成式人工AI阶段,将走向智能体AI时代,随后是物理AI时代。”而在具体思路上,英伟达不仅提供芯片,还会开发对应的软件工具箱和配套服务。换句话说,英伟达不仅卖铲子,也提供全套的保养工具和防护设备,但必须搭配英伟达牌的铲子。在游戏业务里,光线追踪、DLSS等功能必须搭配英伟达的GPU使用;类似的逻辑,英伟达不仅向大模型和云计算公司出售GPU,还会提供NVLink这类通信连接方案、CUDA编程平台与之牢牢绑定。随着今年GTC演讲结束,Cosmos、Newton等软件和模型的发布,一个围绕GPU与“物理AI”的收费站也宣告落成。如果黄仁勋中文水平够高,多少也得来一句“英伟达不造机器人,帮助机器人公司造好机器人”。参考资料

[1] 未来简史,尤瓦尔·赫拉利

[2] 万字长文详解特斯拉自动驾驶体系,自动驾驶之心

[3] 给我一个物理引擎,我也能“预测”世界杯?中科院物理所

[4] “光线追踪”杂谈,电子报

[5]Unimate 机器人:工业自动化的起源,AGV

英伟达凑齐了人形机器人开发“三大件”——超级计算机DGX(训练算力)、融合了Cosmos的仿真平台Omniverse(训练数据)、终端芯片JetsonThor(推理算力)。

春节前夕,黄仁勋照例开启年会巡演,北京站成为各路CEO追星现场。大合照中,坐在黄仁勋左边的是宇树科技的王兴兴,第一排最右是银河通用的王鹤。

三人曾在年初的CES展上有过一次“非正式会谈”,当时黄仁勋演讲到尾声,人形机器人军团压轴登场,其中就包括宇树在春晚转手绢的H1、银河通用的Galbot G1。

英伟达年会与2025年CES展

发布会现场,14台人形机器人一字排开,有波士顿动力这种老牌选手,有宇树这样的行业新贵,还有跨界玩家小鹏,唯独缺席了一边买黄总的芯片一边悄悄搞自研的特斯拉。在机器人军团压轴登场前,黄仁勋公布了一系列大模型组成的机器人训练平台Cosmos。Cosmos的作用可以简单理解为在虚拟世界模拟真实的物理环境,瞄准的是当前人形机器人产业的真空带、也是英伟达围绕人形机器人布局的最后一环——仿真数据。三个月后的英伟达GTC,机器人再度成为压轴节目。除了Cosmos再度刷脸,英伟达还发布了一个人形机器人基础模型Isaac GR00T N1,仿真物理模型Newton,并由小机器人Blue完成收尾。如果把人形机器人视为人工智能领域一条正在疯狂施工的高速公路,那么英伟达正在做的事情,就是提前把收费站先修好。五年高考三年模拟

从年初的CES到前两天的GTC,英伟达真正的关键词是“物理AI”。按照黄仁勋的说法,AI的新一波浪潮是物理AI,其关键环节是让AI理解物理定律,人形机器人则是当下最重要的载体。传统的工业机器人大多基于特定的规划执行特定的操作,比如运输和分拣,与其说机器人,倒不如说是一种“自动化设备”。但人形机器人在理想状态下,可以理解物理世界各种物体、语言和文字的含义,并自主规划和决策。2023年7月,《纽约时报》探班谷歌实验室,记录了一个基于RT-2模型的机器人智能闪现的瞬间:桌子上放着恐龙、鲸鱼、狮子三个塑料玩具,工程师让机器人“捡起灭绝的动物”,机器人拿起了恐龙。这个案例很好的说明了人形机器人最大的变革:机器人不仅能识别三种动物,也能理解“灭绝的动物”的含义,还可以完成具体的操作。也就是说,两者的核心区别在“智能”。判断机器人的智能化程度,不是看它会不会前后空翻大劈叉,而是能不能像人一样思考。和大模型训练一样,让机器人拥有思考能力的过程,同样是对数据的消耗——换句话说就是刷题。人工智能泰斗级人物李飞飞曾对算法的训练过程有一个形象的解释:让算法不断观察包含猫和其他动物的图片,在每张图片背后写下正确答案。计算机每看一次图片,就和背面的答案核对一次。只要次数够多,算法就能学会辨别猫。和GPT等大模型爬取互联网数据不同,机器人会和真实世界产生交互,因此需要遵循物理规则的真实数据来训练算法。但如果用真人动作捕捉来训练,不仅成本高,也容易坐实“AI奴役人类”的地狱笑话。之中的数据空白,就成为了仿真数据的实践空间。所谓仿真数据,可以简单理解为在虚拟空间构建遵循真实世界物理规则的场景,并输出为可以被用来训练的数据。马斯克就是仿真数据的铁杆粉丝,2021年的特斯拉AI Day,马斯克曾公开过自家数据仿真技术,当时生成并投入训练的仿真数据规模就已经达到了37.1亿张图片和4.8亿标注[2]。xAi最新发布的Grok 3,也投喂了大量仿真数据用于训练。自动驾驶尚且可以搜集车主真实的行驶数据用于训练,机器人尚未大规模投入应用,对仿真数据的需求更为迫切。真实数据和仿真数据就像“五年高考”和“三年模拟”,一个是真题,一个是模拟题。真题的参考价值更高,但数量有限,模拟题量大管饱,但参考价值要看它与真题的相似程度。至此,英伟达凑齐了人形机器人开发“三大件”——超级计算机DGX(训练算力)、融合了Cosmos的仿真平台Omniverse(训练数据)、终端芯片Jetson Thor(推理算力)。物理骗术和算力游戏

在虚拟世界构建物理规则这件事上,英伟达的积累恐怕比大部分人想象的深厚。一项技术的应用并不取决于技术本身,而是能否绑定一个高商业价值的场景,实现自我造血的良性循环。在机器人和自动驾驶大规模产业化之前,最匹配这项技术的英伟达的老本行:游戏。大多数游戏都是对现实世界的模拟,但虚拟世界并不遵循现实世界的物理规则,小到游戏世界草木树叶飘动的方向、服装布料的褶皱,大到刀剑挥砍的力度和反馈效果,都会影响游戏的“沉浸感”。一种改进思路由此产生:为什么不用物理公式计算物体的实时运动状态、设计运动轨迹呢?当时,一家名叫Ageia的初创公司开发了物理引擎PhysX,通过对游戏画面中的物体做“受力分析->代入运动方程->更新位置信息->输出”的实时循环计算[3],让游戏中的场景尽可能贴合真实世界的物理规则。由于PhysX需要消耗大量算力,Ageia还专门开发了配套的硬件PPU(Physics Processing Unit)专门负责物理运算。可惜PPU销量惨淡,Ageia濒临倒闭,黄仁勋骑着白马就来了。收购完成后,英伟达干的第一件事就是砍掉PPU产品线,将PhysX的计算工作交给自家的GPU,并推出针对游戏开发的软件工具箱PhysX APEX,降低使用门槛。由于PhysX的特性是对物理规则的模拟和仿真,此后几年,英伟达还推动了PhysX在医疗手术、影视特效等工业场景的应用。2019年,英伟达在GPU架构中引入RT核心,推出了光线追踪功能。和PhysX类似,光线追踪的核心同样是对真实物理规则的模拟——根据物体和光源、障碍物间的相对位置,实时计算出光线反射至人眼的状态[4],每束光线的实时计算结果组合成一帧的画面,让英伟达狠狠秀了一把算力的肌肉。伴随自动驾驶、人形机器人这些新产业的出现,“在虚拟世界模拟物理规则”的需求也越来越大。Cosmos和Omniverse等软件工具的出现,相当于英伟达给人形机器人建了个可以沉浸式训练的“健身房”,接下来就可以卖“私教课”了——你看我的芯片怎么样?英伟达的野心

过去二十年,英伟达的经营思路可以用一句话来概括:让高性能计算不断覆盖高价值的场景。GPU是高性能计算的载体,也是英伟达的核心产品。2010年之前,虽然一些学者已经开始使用GPU训练神经网络,但GPU对应的高价值场景其实只有游戏一个。按照黄仁勋的说法,游戏市场“既代表着最棘手的技术难题,又具备惊人的市场规模,同时拥有这两个特质的市场非常罕见。”英伟达开拓的第一个新场景是移动设备。2013年小米3发布,处理器采用高通骁龙800和英伟达的Tegra系列混搭,是英伟达切入手机市场,开辟显卡之外第二战线的绝佳机会。当时,英文不好的雷军和中文不好的黄仁勋罕见同台,黄仁勋现场还当了一回米粉。可惜Tegra芯片因为制程和外挂基带问题,能耗失控发热严重。英伟达的移动业务此后也未见起色,Tegra系列只能在任天堂Switch上发挥余热。后来黄仁勋去台大演讲,称英伟达“主动放弃”了智能手机市场。第二个场景是自动驾驶。最先吃螃蟹的是特斯拉,Model S/X都曾搭载过英伟达的方案。黄仁勋也从米粉变成特斯拉车主,跟马斯克如胶似漆。虽然特斯拉后来用自研方案替代了英伟达,但有了榜样的力量,英伟达还是顺利打入造车新势力内部。不过汽车业务在英伟达的版图中远不如游戏和数据中心耀眼,营收占比几乎从未超过5%。第三个场景是人工智能。ChatGPT的横空出世让英伟达彻底打开收入天花板,计算机视觉、大语言模型等前沿计算机科学统统都离不开英伟达的芯片,也让后者成为了全球市值最高的半导体公司。2016年,马斯克作为OpenAI董事长签收英伟达DXG-1第四个场景就是人形机器人,以及更加广阔的“物理AI”。按照黄仁勋的说法,“我们正处于生成式人工AI阶段,将走向智能体AI时代,随后是物理AI时代。”而在具体思路上,英伟达不仅提供芯片,还会开发对应的软件工具箱和配套服务。换句话说,英伟达不仅卖铲子,也提供全套的保养工具和防护设备,但必须搭配英伟达牌的铲子。在游戏业务里,光线追踪、DLSS等功能必须搭配英伟达的GPU使用;类似的逻辑,英伟达不仅向大模型和云计算公司出售GPU,还会提供NVLink这类通信连接方案、CUDA编程平台与之牢牢绑定。随着今年GTC演讲结束,Cosmos、Newton等软件和模型的发布,一个围绕GPU与“物理AI”的收费站也宣告落成。如果黄仁勋中文水平够高,多少也得来一句“英伟达不造机器人,帮助机器人公司造好机器人”。参考资料

[1] 未来简史,尤瓦尔·赫拉利

[2] 万字长文详解特斯拉自动驾驶体系,自动驾驶之心

[3] 给我一个物理引擎,我也能“预测”世界杯?中科院物理所

[4] “光线追踪”杂谈,电子报

[5]Unimate 机器人:工业自动化的起源,AGV